CheckMag | GPU yoksa sorun da yok. Kendi LLM'nizi barındırmak, büyük oyuncuların sansürlü tekliflerinden çok daha eğlenceli ve şaşırtıcı derecede iyi çalışıyor.

Bir yapay zekayı sorguladığınızda verilerinize gerçekte ne olduğu hemen hemen herkesin tahminidir, ancak ne olursa olsun, artık kesinlikle size ait değildir.

Birlikte görüntü büyük Dil Modelleri (LLM) ile denemeler yapmak istiyor ancak verilerinizi büyük teknolojilere teslim etmek istemiyorsanız, kendi verilerinizi barındırmak şaşırtıcı derecede kolaydır ve büyük oyunculara göre çeşitli avantajları vardır.

Öncelikle, ne yapmayı seçerseniz seçin, tüm verileriniz sizin kontrolünüz altında kalır ve eğer verilerinizi Mechahitler'e teslim etmek istemiyorsanızbu hemen bir artı. Ayrıca, Deepseek, Gemma2 veya GPT olsun, içine attığınız sorgu türlerini kısıtlamayan sürümleri kullanabilmenin ek avantajı ile istediğiniz herhangi bir modeli kullanabilirsiniz.

KoboldCPP, GGUF ve GGML Büyük Dil Modellerini çalıştırmak için tasarlanmış, kullanımı kolay, tek çalıştırılabilir bir yapay zeka metin oluşturma aracıdır. Hem GPU hem de CPU'yu destekler ve AI hikaye anlatımı ve sohbet için özel bir arka uç olarak hareket edebilir. KoboldCPP GitHub'dan indirilebilir buradan ve Windows, Linux, Mac veya Docker için kullanılabilir.

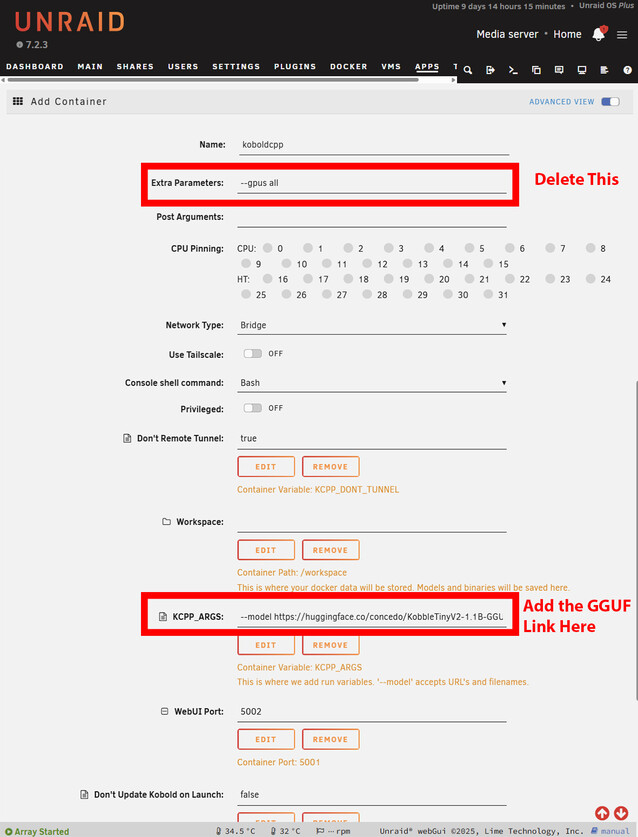

Bir konteynırda barındırmak, LLM'yi ağınızdaki her cihaza maruz bırakmayı önemsiz hale getirir ve Unraid ve TrueNAS dahil olmak üzere ana platformlar için önceden oluşturulmuş şablonlar vardır. Güvenlik duvarınıza gerekli kuralları eklediğiniz sürece aynı şey diğer kurulumlarla da gerçekleştirilebilir.

Başlarken

Tercih ettiğiniz platforma karar verdikten sonra, hangi modeli kullanacağınızı bulmanız gerekecektir. Kucaklayan Yüz modelleri aramak için en iyi yerdir ve GGUF formatında olmaları gerekir.

D&D senaryolarına ev sahipliği yapmayı planlıyorsanız, kesinlikle sansürsüz bir model isteyeceksiniz, aksi takdirde LLM sonuçta karakterlerden herhangi birine zarar vermeyi reddedecek ve istenmeyen sonuçlar.

Deepseek gibi bazı modeller ve Claude'nin "düşünme" eğilimi vardır, bu da temelde sorgunuzun tüm düşünce sürecini ortaya çıkarır. Bu, ağır işleri yapan bir GPU ile iyi olabilir, ancak bir GPU olmadan süreci önemli ölçüde yavaşlatır. Sizin için uygun olanı bulmak için modellerle denemeler yapmanız gerekecektir, ancak Gemma2 başlamak için iyi bir yerdir.

Dosyalar sayfasını bulun ve GGUF dosyasına bağlantı veren URL'yi kopyalayın. Birçok modelin birden fazla boyutu vardır, bu nedenle mevcut RAM'inizin sınırlamalarına uyan birini seçmeniz gerekecektir.

Top 10

» Top 10 Multimedia Notebook listesi

» Top 10 oyun notebooku

» Top 10 bütçeye uygun Ofis/İş Notebook Listesi

» Top 10 Premium Ofis/İş notebookları

» Top 10 Çalışma istasyonu laptopları

» Top 10 Subnotebook listesi

» Top 10 Ultrabooklar

» En iyi 10 dönüştürülebilir modeli

» Seçimi en iyi 10 tablet

» Notebookcheck Top 10 Windows Tabletleri

» Top 10 Subnotebook listesi

» NotebookCheck tarafından incelenen en iyi Notebook ekranları

» Notebookcheck'in 500 Euro altındaki en iyi 10 Notebook listesi

» NotebookCheck tarafından seçilen 300 Euro altındaki en iyi 10 Notebook

» Notebookcheck'in 500 Euro altındaki en iyi 10 Notebook listesi

» Notebookcheck'in Top 10 akıllı telefon listesi

» Notebookcheck'in Top 10 hafif oyun notebookları

Windows'ta kurulum büyük ölçüde aynıdır. Ancak, NoCUDA adresini indirmeniz gerekecektir gPU olmadan kullanıyorsanız sürüm. KoboldCPP size arayüzü sunmadan önce modeli indireceği için başlaması biraz zaman alabilir. Windows'ta bu açıktır, ancak Unraid veya TrueNAS'ta indirme işleminin ilerleyişini görmek için günlükleri açmanız gerekir. Unraid üzerinde, adresini artırmanız gerekebilir seçtiğiniz modelin ne kadar büyük olduğuna bağlı olarak Docker konteynerlerinin kullanılabilir depolama alanı.

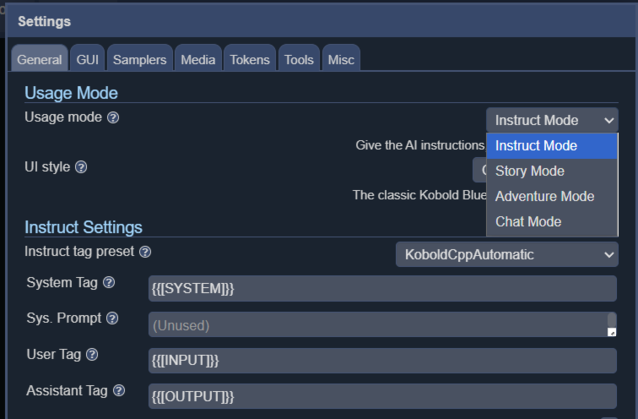

KoboldCPP, talimat, hikaye, sohbet ve macera dahil olmak üzere 4 farklı arayüz modu sunar.

Hayal gücünün en hızlısı olmasa da, metin ortalama okuma hızından biraz daha yavaş üretilir. D&D senaryoları için 16 çekirdekli AMD 5950x(Amazon'da mevcut) üzerinde çalışırken mükemmel bir şekilde kullanılabilir ve muhtemelen daha modern CPU'larda daha hızlı çalışacaktır. Ne kadar çok çekirdek kullanırsanız o kadar iyi olur ve makul miktarda RAM daha büyük modelleri çalıştırmanıza izin verir, ancak 16GB ile iyi olursunuz. Modelin boyutu ve türü de nesil hızı üzerinde önemli bir etkiye sahip olacaktır ve daha hafif bir model seçmek genel hızı önemli ölçüde artırabilir.

Açıkçası, en iyi deneyim için Büyük Dil Modellerini bir GPU ile çalıştırmak en uygunudur, ancak ChatGPT, Claude veya Gemini'nin kısıtlamalarını veya veri gizliliği etkilerini atlayarak kendi ev sahipliğinizi denemek istiyorsanız, başlamak için herhangi bir süslü donanıma ihtiyacınız yoktur ve yine de iyi bir deneyim elde edebilirsiniz.